La Inteligencia Artificial y la Ciberseguridad: Un Desafío en Auge

La inteligencia artificial (IA) se ha consolidado como un elemento esencial en nuestra vida cotidiana. Desde asistentes virtuales hasta sistemas de recomendación, la IA se encuentra en casi todos los aspectos de nuestra existencia. Figuras destacadas del mundo tecnológico, como Bill Gates, cofundador de Microsoft, han sugerido que la IA podría representar el futuro de la tecnología. Sin embargo, a medida que la IA se vuelve más prevalente, también aumenta la necesidad de abordar los desafíos de ciberseguridad y el potencial incremento de la productividad que puede ofrecer.

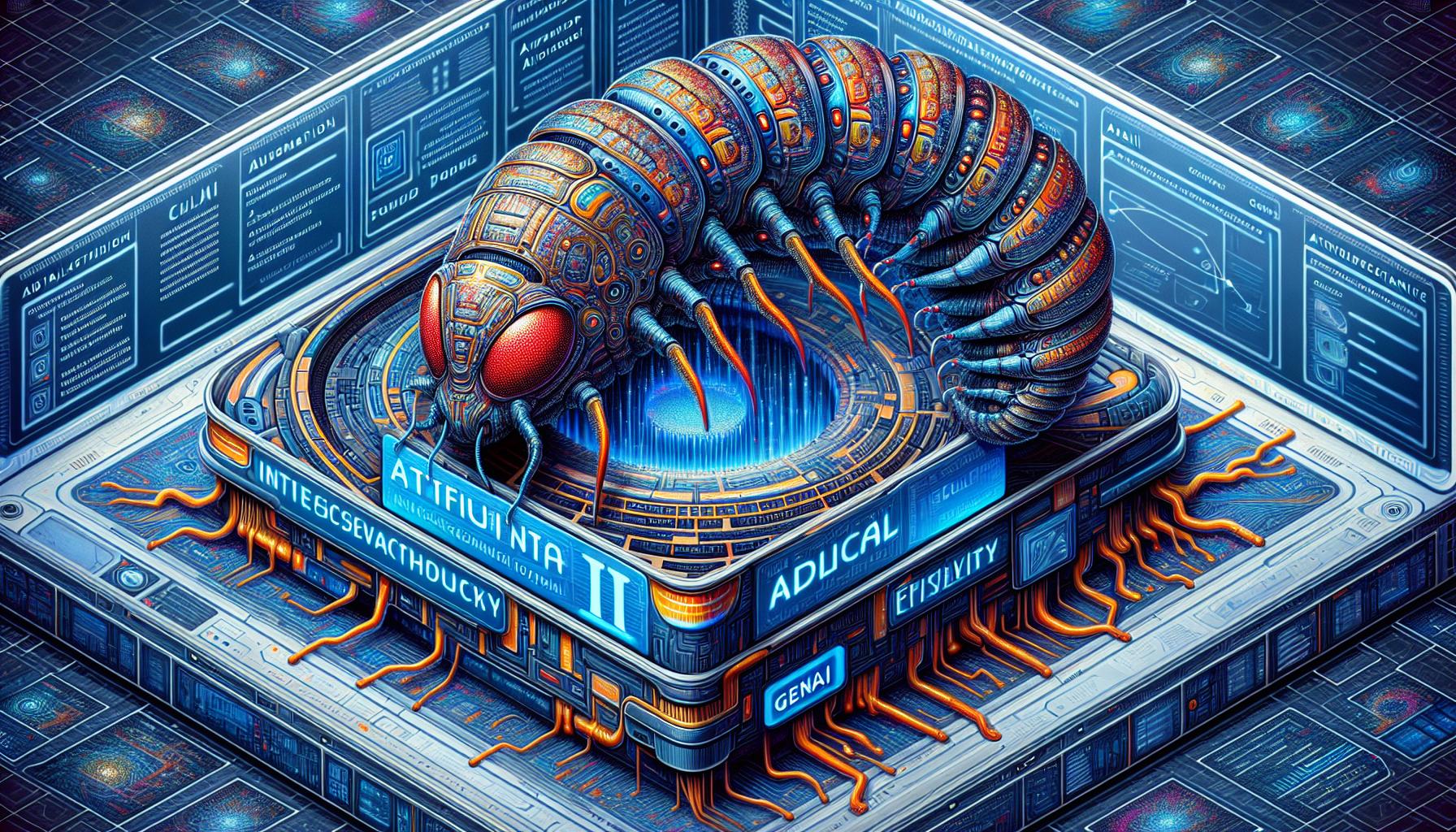

«Morris II»: Una Alerta sobre la Seguridad en la IA

En este contexto, un equipo de expertos de la Universidad de Cornell ha desarrollado «Morris II«, el primer gusano diseñado para atacar ecosistemas GenAI. Este proyecto busca alertar sobre la posibilidad real de crear este tipo de amenazas, subrayando la necesidad de una mayor seguridad en el ámbito de la IA.

«Morris II» ha sido utilizado para demostrar ataques de día cero contra un servicio de correo electrónico con IA generativa. En pruebas con Gemini Pro de Google y GPT-4 de OpenAI, el gusano demostró ser capaz de autoreplicarse y robar datos. Su funcionamiento se basa en el uso de Adversarial Self-Replicating Prompt, una técnica que permite comprometer la seguridad del sistema de correo electrónico, infectar otros sistemas y difundir contenido personalizado. Además, «Morris II» puede comprometer la funcionalidad RAG para extraer información de fuentes externas y replicarse.

Las Repercusiones de la Investigación y la Necesidad de Mejorar la Seguridad de la IA

Las implicaciones de esta investigación son significativas. Los hallazgos han sido enviados a Google y OpenAI, destacando que el problema radica en un mal diseño en la arquitectura de los ecosistemas de GenAI, y no en las vulnerabilidades de los modelos de lenguaje. Los detalles de la investigación están disponibles en un artículo público, lo que permite a otros expertos en el campo aprender de estos hallazgos y trabajar en soluciones para mejorar la seguridad de la IA.

En conclusión, a medida que la IA se convierte en una parte cada vez más integral de nuestra vida cotidiana, es esencial que se tomen medidas para garantizar su seguridad. La creación de «Morris II» por parte de la Universidad de Cornell es un paso importante en esta dirección, ya que destaca las posibles amenazas y ofrece una visión de cómo podrían ser los futuros ataques a la IA.

Susana es una profesional destacada en marketing y comunicación, creadora de contenido y experta en SEO. Es licenciada en Psicología por la Universidad de Santiago de Compostela y cuenta con un máster en Marketing y Comportamiento del Consumidor de la Universidad de Granada y la Universidad de Jaén. Además, ha compartido sus conocimientos a través de conferencias y workshops.

Con amplia experiencia en estrategias de marketing y comunicación, Susana ha logrado optimizar la visibilidad y el posicionamiento de las marcas a través de técnicas de SEO.