La Inteligencia Artificial en la Vida Cotidiana: Ventajas y Riesgos

La inteligencia artificial (IA) se ha convertido en una herramienta cada vez más presente en nuestra vida cotidiana. Un ejemplo de ello es ChatGPT, un modelo de lenguaje generativo desarrollado por OpenAI que se utiliza para mantener conversaciones en línea. A pesar de que OpenAI ha asegurado que no tiene acceso a las conversaciones individuales, es crucial recordar que no debemos compartir información confidencial a través de estas plataformas.

Vulnerabilidad de la IA: El Caso de ChatGPT

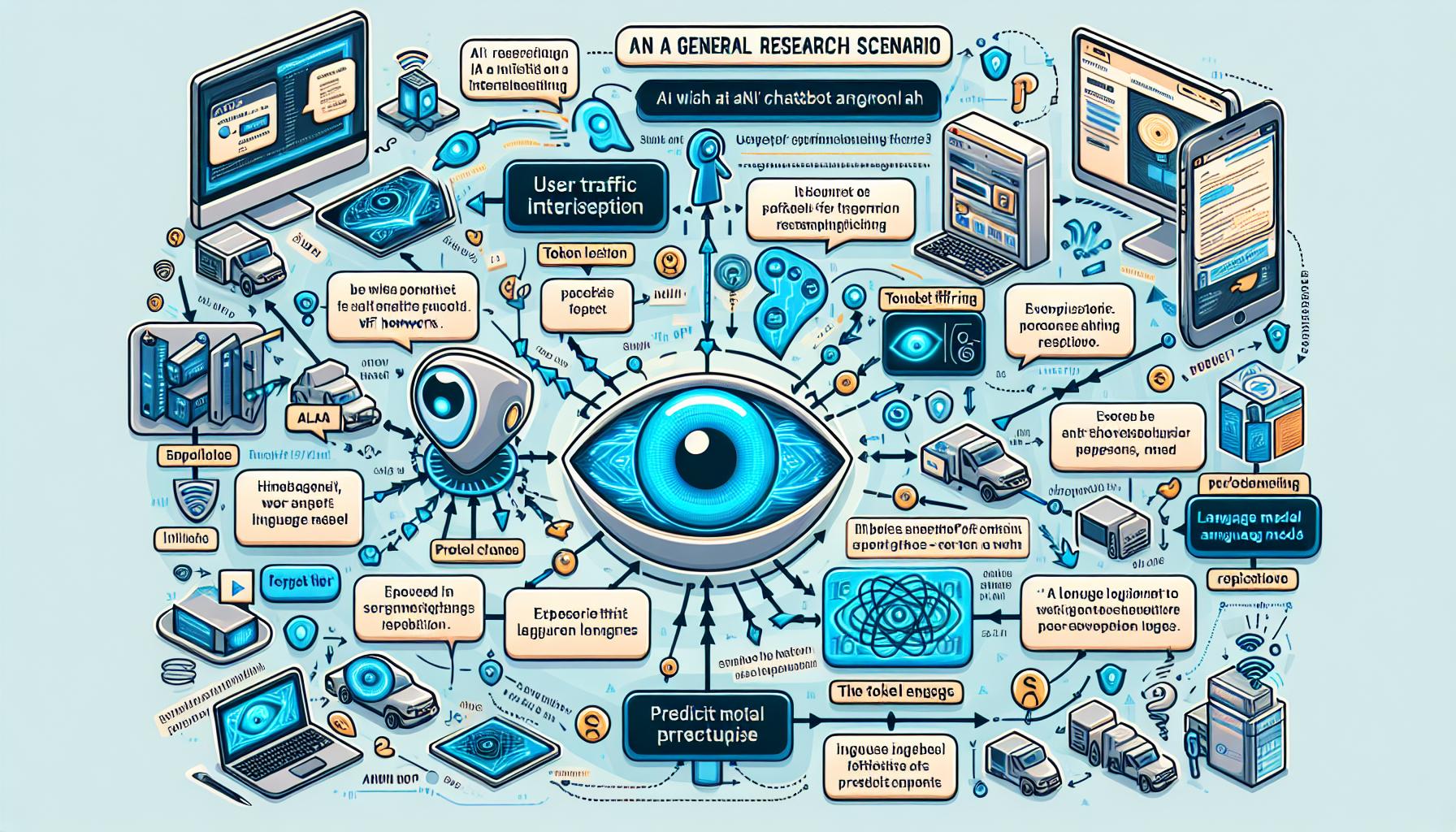

Un estudio reciente de la Universidad Ben-Gurion en Israel ha desvelado un escenario de vulnerabilidad en el que un ciberataque podría comprometer la seguridad de ChatGPT. Este escenario se produce cuando se utiliza ChatGPT en una red WiFi pública, lo que permite a un atacante interceptar el tráfico de la víctima, filtrar los paquetes para hallar respuestas de ChatGPT, revelar la longitud de los tokens y, finalmente, inferir la respuesta de ChatGPT utilizando un modelo de lenguaje de máquina (LLM).

El proceso de ataque es bastante complejo. ChatGPT transmite tokens de manera secuencial, lo que permite un ataque de tipo Side-channel para inferir información. El atacante puede interceptar estos datos mediante un ataque Man-in-the-Middle, filtrar el tráfico y analizar los paquetes para detectar patrones. Una vez identificada la longitud de los tokens, el atacante puede utilizar un LLM para interpretar los tokens e inferir las respuestas.

Los resultados del ataque son sorprendentes. El LLM fue capaz de predecir las respuestas de ChatGPT con un alto grado de precisión. En algunos casos, la precisión fue perfecta, lo que significa que el atacante pudo inferir la respuesta exacta de ChatGPT.

La Importancia de la Seguridad en la IA

Estos hallazgos nos recuerdan la necesidad de tener en cuenta la exposición de nuestros datos cuando utilizamos tecnologías de IA. Aunque este estudio se centró en ChatGPT, la técnica de ataque podría aplicarse a otros bots de inteligencia artificial. Sin embargo, hay excepciones, como Gemini de Google, cuya arquitectura diferente lo hace inmune a este tipo de ataques.

En conclusión, aunque la IA ofrece muchas ventajas, también puede presentar riesgos de seguridad. Es importante ser conscientes de estos riesgos y tomar las precauciones necesarias para proteger nuestra información.

Susana es una profesional destacada en marketing y comunicación, creadora de contenido y experta en SEO. Es licenciada en Psicología por la Universidad de Santiago de Compostela y cuenta con un máster en Marketing y Comportamiento del Consumidor de la Universidad de Granada y la Universidad de Jaén. Además, ha compartido sus conocimientos a través de conferencias y workshops.

Con amplia experiencia en estrategias de marketing y comunicación, Susana ha logrado optimizar la visibilidad y el posicionamiento de las marcas a través de técnicas de SEO.