Le langage et la vie privée à l’ère numérique

Le langage, cet outil puissant qui nous permet de communiquer, exprimer nos idées et partager des informations, prend une nouvelle dimension à l’ère numérique. Dans ce contexte, son utilisation peut déclencher des implications inattendues en matière de vie privée. Les modèles de langage, des programmes informatiques capables de générer du texte humain, peuvent inférer des informations privées à partir de l’utilisation spécifique du langage. Un exemple clair serait si quelqu’un mentionne dans une conversation en ligne qu’il vit près d’un restaurant spécifique à New York, un modèle de langage pourrait inférer son emplacement exact.

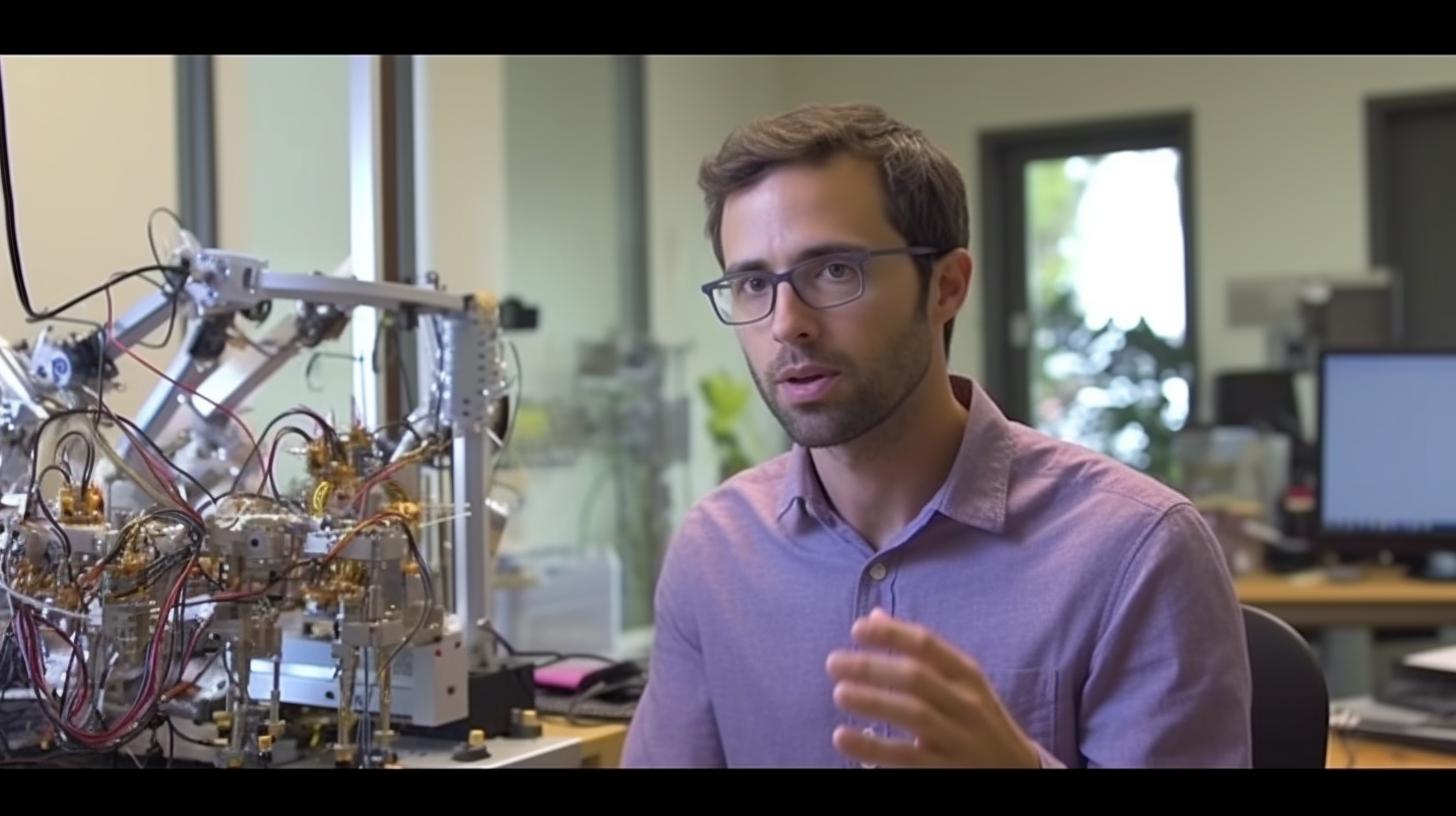

Des experts donnent leur avis sur les modèles de langage et la vie privée

Taylor Berg-Kirkpatrick, professeur associé à l’Université de Californie à San Diego, n’est pas surpris que les modèles de langage puissent déterrer des informations privées. Selon lui, ces modèles sont largement disponibles et peuvent prédire des informations privées avec une grande précision. Cependant, il souligne également la possibilité d’utiliser un autre modèle d’apprentissage automatique pour réécrire du texte et masquer des informations personnelles.

De son côté, Mislav Balunović, doctorant qui a étudié ce sujet, soutient que les grands modèles de langage sont formés avec de nombreux types de données différents. Cela leur permet d’inférer des informations surprenantes avec une précision relative. Selon Balunović, la suppression de données telles que l’âge ou la localisation n’empêche pas le modèle de faire des inférences puissantes.

Les défis posés par les modèles de langage

Une équipe de chercheurs à Zurich a fait des découvertes similaires en utilisant des modèles de langage non spécifiquement conçus pour deviner des données personnelles. Selon eux, il est possible d’utiliser de grands modèles de langage pour rechercher des informations personnelles sensibles sur les réseaux sociaux. Ils pourraient même concevoir un chatbot pour déterrer des informations en posant une série de questions apparemment innocentes.

Cependant, ce pouvoir des modèles de langage soulève également des problèmes et des défis. Les chercheurs ont démontré comment les grands modèles de langage peuvent divulguer des informations personnelles spécifiques. Les entreprises tentent d’éliminer les informations personnelles des données d’entraînement ou de bloquer les modèles pour qu’ils ne les produisent pas. Mais selon Martin Vechev, professeur à l’ETH Zurich, la capacité des modèles de langage à inférer des informations personnelles est fondamentale pour leur fonctionnement, ce qui rend difficile leur résolution. Vechev affirme que ce problème est très différent et bien pire que d’autres problèmes liés à la vie privée.

En conclusion, bien que les modèles de langage puissent être des outils utiles pour générer du texte humain, ils peuvent également représenter une menace pour la vie privée. Il est essentiel que nous continuions à rechercher et à développer des moyens de protéger nos informations personnelles à l’ère numérique.

Sarah est non seulement une experte en marketing digital, mais aussi une créatrice de contenu avec une grande expérience dans le domaine. Diplômée en Sociologie de l'Université de Barcelone et ayant un post-diplôme en Marketing Digital de l'Inesdi, Sarah a réussi à se distinguer en tant que Directrice de Marketing Digital. Sa connaissance approfondie des tendances digitales et sa capacité à identifier des opportunités de croissance ont été fondamentales pour le succès de nombreuses campagnes. De plus, elle donne des cours et des conférences dans des écoles de commerce prestigieuses, des universités et des événements, partageant ses connaissances et expériences avec d'autres professionnels et étudiants.

Cette entrée est également disponible dans : Español Português