L’Intelligence Artificielle et la Cybersécurité : Un Défi Croissant

L’intelligence artificielle (IA) s’est imposée comme un élément essentiel de notre vie quotidienne. Des assistants virtuels aux systèmes de recommandation, l’IA est présente dans presque tous les aspects de notre existence. Des figures éminentes du monde technologique, comme Bill Gates, cofondateur de Microsoft, ont suggéré que l’IA pourrait représenter l’avenir de la technologie. Cependant, à mesure que l’IA devient plus prévalente, la nécessité de relever les défis de la cybersécurité et le potentiel d’augmentation de la productivité qu’elle peut offrir s’accroît également.

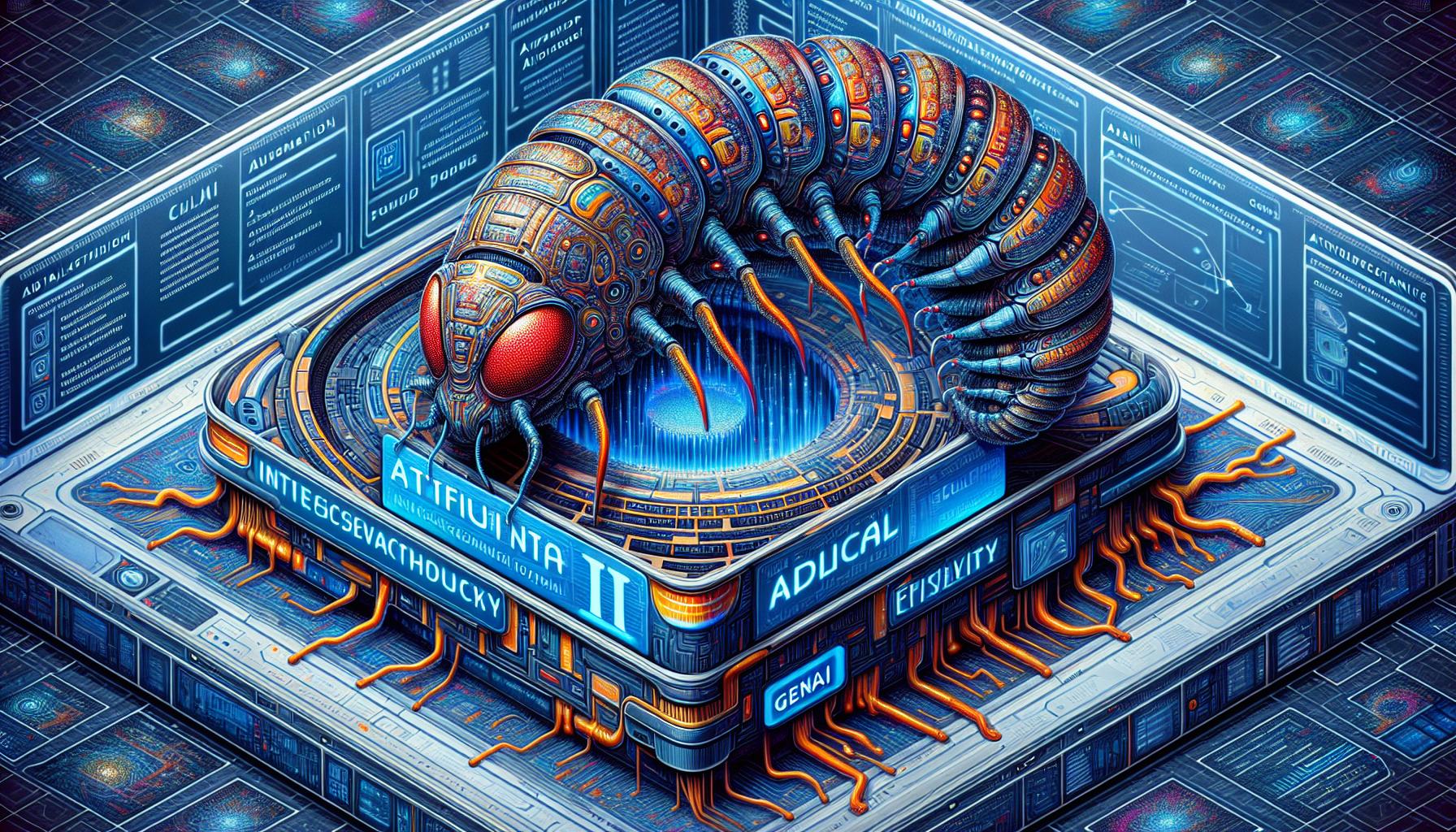

«Morris II» : Une Alerte sur la Sécurité de l’IA

Dans ce contexte, une équipe d’experts de l’Université de Cornell a développé «Morris II», le premier ver conçu pour attaquer les écosystèmes GenAI. Ce projet vise à alerter sur la possibilité réelle de créer ce type de menaces, soulignant la nécessité d’une sécurité accrue dans le domaine de l’IA.

«Morris II» a été utilisé pour démontrer des attaques de jour zéro contre un service de courrier électronique avec IA générative. Dans les tests avec Gemini Pro de Google et GPT-4 d’OpenAI, le ver a démontré être capable de s’autorépliquer et de voler des données. Son fonctionnement est basé sur l’utilisation d’Adversarial Self-Replicating Prompt, une technique qui permet de compromettre la sécurité du système de courrier électronique, d’infecter d’autres systèmes et de diffuser du contenu personnalisé. De plus, «Morris II» peut compromettre la fonctionnalité RAG pour extraire des informations de sources externes et se répliquer.

Les Répercussions de la Recherche et le Besoin d’Améliorer la Sécurité de l’IA

Les implications de cette recherche sont significatives. Les résultats ont été envoyés à Google et OpenAI, soulignant que le problème réside dans une mauvaise conception de l’architecture des écosystèmes de GenAI, et non dans les vulnérabilités des modèles de langage. Les détails de la recherche sont disponibles dans un article public, ce qui permet à d’autres experts dans le domaine d’apprendre de ces découvertes et de travailler sur des solutions pour améliorer la sécurité de l’IA.

En conclusion, alors que l’IA devient une partie de plus en plus intégrante de notre vie quotidienne, il est essentiel de prendre des mesures pour garantir sa sécurité. La création de « Morris II » par l’Université de Cornell est une étape importante dans cette direction, car elle met en évidence les menaces potentielles et offre une vision de ce que pourraient être les futures attaques contre l’IA.

Susana est une professionnelle remarquable dans le marketing et la communication, créatrice de contenu et experte en SEO. Elle est diplômée en Psychologie de l'Université de Santiago de Compostela et a un master en Marketing et Comportement du Consommateur de l'Université de Grenade et de l'Université de Jaén. De plus, elle a partagé ses connaissances à travers des conférences et des ateliers. Avec une vaste expérience en stratégies de marketing et de communication, Susana a réussi à optimiser la visibilité et le positionnement des marques grâce à des techniques de SEO.

Cette entrée est également disponible dans : Español Português