L’Importance de la Sécurité dans les Modèles d’Apprentissage Automatique

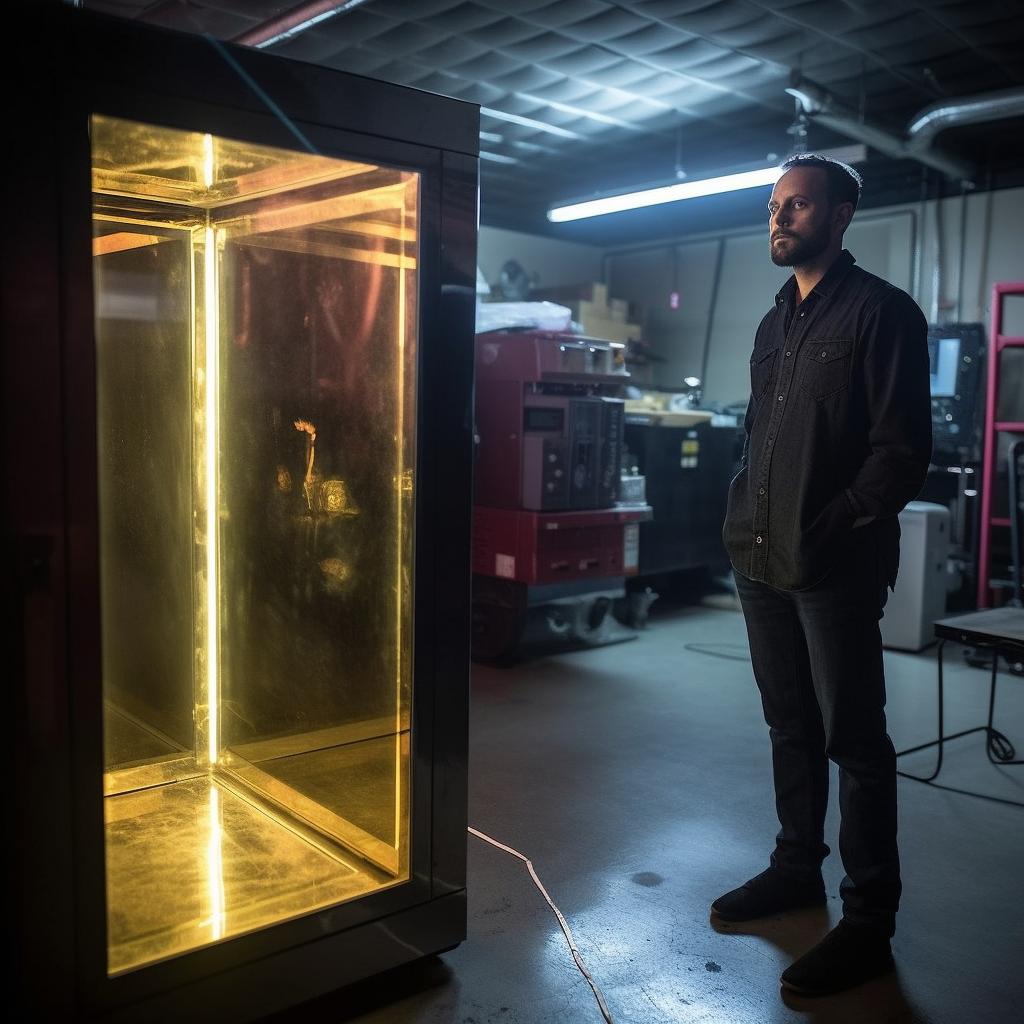

Jason Clinton, chef de la sécurité de l’information chez Anthropic, a une responsabilité cruciale : protéger les poids du modèle Claude. Ce modèle est un composant essentiel dans l’apprentissage automatique et les réseaux neuronaux profonds, et sa sécurité est d’une importance vitale.

Les poids du modèle jouent un rôle fondamental dans les réseaux neuronaux profonds. Un rapport de la Rand Corporation souligne que la protection de ces poids est critique pour la sécurité et l’efficacité des systèmes d’intelligence artificielle (IA). Cependant, Clinton exprime une préoccupation quant à l’accès inapproprié à ces poids, une inquiétude qui se reflète dans le récent décret exécutif de la Maison Blanche sur le développement sûr et fiable de l’IA.

Recherche sur les Attaques et l’Usage Abusif Potentiel

L’étude sur les attaques potentielles contre les poids du modèle est alarmante. Le rapport de Rand identifie jusqu’à 40 vecteurs d’attaque différents. De plus, il y a des préoccupations futures concernant l’utilisation abusive possible de ces modèles pour le développement d’armes biologiques.

Le débat sur les risques et les avantages des modèles ouverts est en plein essor. Certains plaident en faveur de la restriction des poids du modèle dans l’IA ouverte, tandis que d’autres défendent leur libération. Un exemple notable est le modèle Llama 2 de Meta, qui a été libéré avec des poids de modèle largement disponibles.

Voix Pour et Contre l’Accès Ouvert

Nicolas Patry et William Falcon sont deux voix éminentes qui plaident pour la transparence et l’ouverture dans les modèles d’IA. D’un autre côté, Clinton explique comment Anthropic utilise Claude pour développer des outils de défense contre les menaces cybernétiques.

En regardant vers l’avenir, Neva et Clinton soulignent tous deux la nécessité de se préparer à de futures menaces. La pénurie d’ingénieurs en sécurité qualifiés et l’évolution rapide du domaine sont des défis qui doivent être relevés. En fin de compte, l’équilibre entre permettre la recherche et maintenir la sécurité des poids du modèle sera clé pour le progrès sûr et efficace de l’IA.

En conclusion, la sécurité des poids du modèle dans l’apprentissage automatique est une préoccupation croissante. Alors que nous avançons vers un avenir de plus en plus numérique, il est essentiel que les entreprises et les individus soient prêts à protéger ces modèles et à les utiliser de manière sûre et efficace.

Clara est créatrice et éditrice de contenus, avec une solide formation en sciences et une spécialisation en intelligence artificielle. Sa passion pour ce domaine en constante évolution l'a amenée à acquérir les connaissances nécessaires pour comprendre et communiquer les avancées les plus récentes dans ce domaine. Grâce à son expérience et à ses compétences en rédaction et édition de contenus, Clara est capable de transmettre de manière claire et efficace des concepts complexes liés à l'intelligence artificielle et ainsi les rendre accessibles à tous types de publics.

Cette entrée est également disponible dans : Español Português