A Importância da Segurança nos Modelos de Aprendizado de Máquina

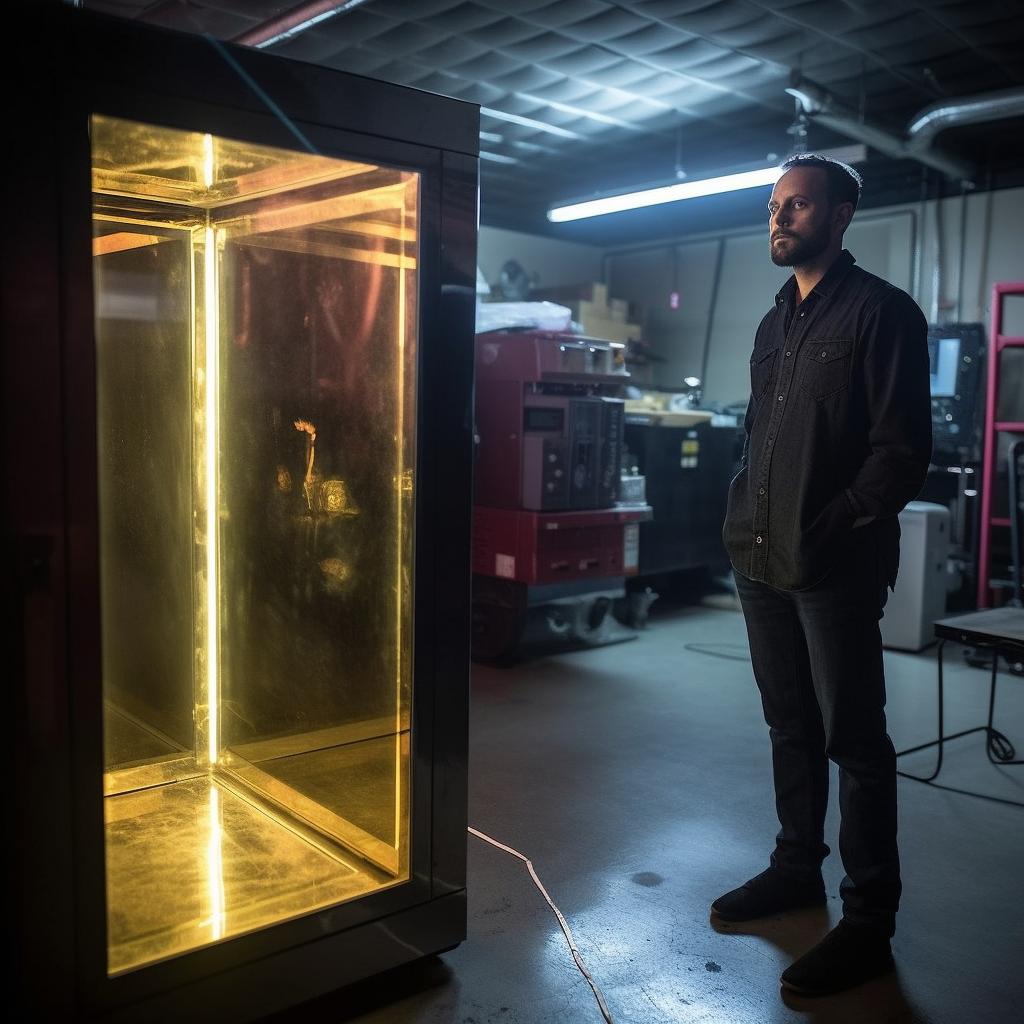

Jason Clinton, chefe de segurança da informação na Anthropic, tem uma responsabilidade crucial: proteger os pesos do modelo Claude. Este modelo é um componente essencial no aprendizado de máquina e nas redes neurais profundas, e sua segurança é de vital importância.

Os pesos do modelo desempenham um papel fundamental nas redes neurais profundas. Um relatório da Rand Corporation destaca que a proteção desses pesos é crítica para a segurança e eficácia dos sistemas de inteligência artificial (IA). No entanto, Clinton mostra preocupação com o acesso indevido a esses pesos, uma preocupação que se reflete na recente Ordem Executiva da Casa Branca sobre o desenvolvimento seguro e confiável da IA.

Pesquisa sobre Ataques e Uso Indevido Potencial

O estudo sobre possíveis ataques aos pesos do modelo é alarmante. O relatório da Rand identifica até 40 vetores de ataque distintos. Além disso, existem preocupações futuras sobre o possível uso indevido desses modelos para o desenvolvimento de armas biológicas.

O debate sobre os riscos e benefícios dos modelos abertos está em pleno desenvolvimento. Alguns argumentam a favor de restringir os pesos do modelo em IA aberta, enquanto outros defendem sua liberação. Um exemplo notável é o modelo Llama 2 da Meta, que foi liberado com pesos do modelo amplamente disponíveis.

Vozes a Favor e Contra o Acesso Aberto

Nicolas Patry e William Falcon são duas vozes proeminentes que defendem a transparência e abertura em modelos de IA. Por outro lado, Clinton explica como a Anthropic está usando Claude para desenvolver ferramentas de defesa contra ameaças cibernéticas.

Olhando para o futuro, tanto Neva quanto Clinton enfatizam a necessidade de se preparar para futuras ameaças. A escassez de engenheiros de segurança qualificados e a rápida evolução do campo são desafios que devem ser enfrentados. Em última análise, o equilíbrio entre permitir a pesquisa e manter seguros os pesos do modelo será chave para o progresso seguro e efetivo da IA.

Em conclusão, a segurança dos pesos do modelo em aprendizado de máquina é uma preocupação crescente. À medida que avançamos para um futuro cada vez mais digital, é essencial que as empresas e indivíduos estejam preparados para proteger esses modelos e utilizá-los de maneira segura e eficaz.

Clara é criadora e editora de conteúdo, com sólida formação em ciências e especialização em inteligência artificial. Sua paixão por este campo em constante evolução levou-a a adquirir os conhecimentos necessários para entender e comunicar os avanços mais recentes nesta área. Com sua experiência e habilidades em redação e edição de conteúdo, Clara é capaz de transmitir de maneira clara e eficaz conceitos complexos relacionados à inteligência artificial, tornando-os acessíveis a todos os tipos de públicos.